filtre:

Anthropic

2026

Le ministre de la Défense avait fixé un ultimatum à la société qui refuse que son outil serve à la surveillance de masse des citoyens américains et à l’usage d’armes mortelles entièrement autonomes. Ce vendredi soir, Donald Trump a ordonné aux agences fédérales de cesser d’y avoir recours.

Le président des Etats-Unis a ordonné à son administration de « cesser immédiatement » toute collaboration avec la start-up, qui a refusé d’ouvrir son modèle sans restriction à l’armée. OpenAI, de son côté, a annoncé un accord avec le Pentagone.

Le dirigeant a refusé la demande de lever toute limite à l’utilisation de son modèle Claude par l’armée américaine. « Le Monde » reproduit et traduit son communiqué, diffusé jeudi.

Donald Trump a ordonné à toutes les agences fédérales de cesser immédiatement d'utiliser l'IA d'Anthropic, après que la start-up a refusé de la rendre totalement accessible à l'armée américaine.

Dario Amodei, le PDG de l’entreprise d’intelligence artificielle, assume des désaccords avec la Maison Blanche sur la régulation ou l’utilisation militaire de sa technologie. Une posture rare aux Etats-Unis, où le monde de la tech a plutôt fait allégeance au président américain.

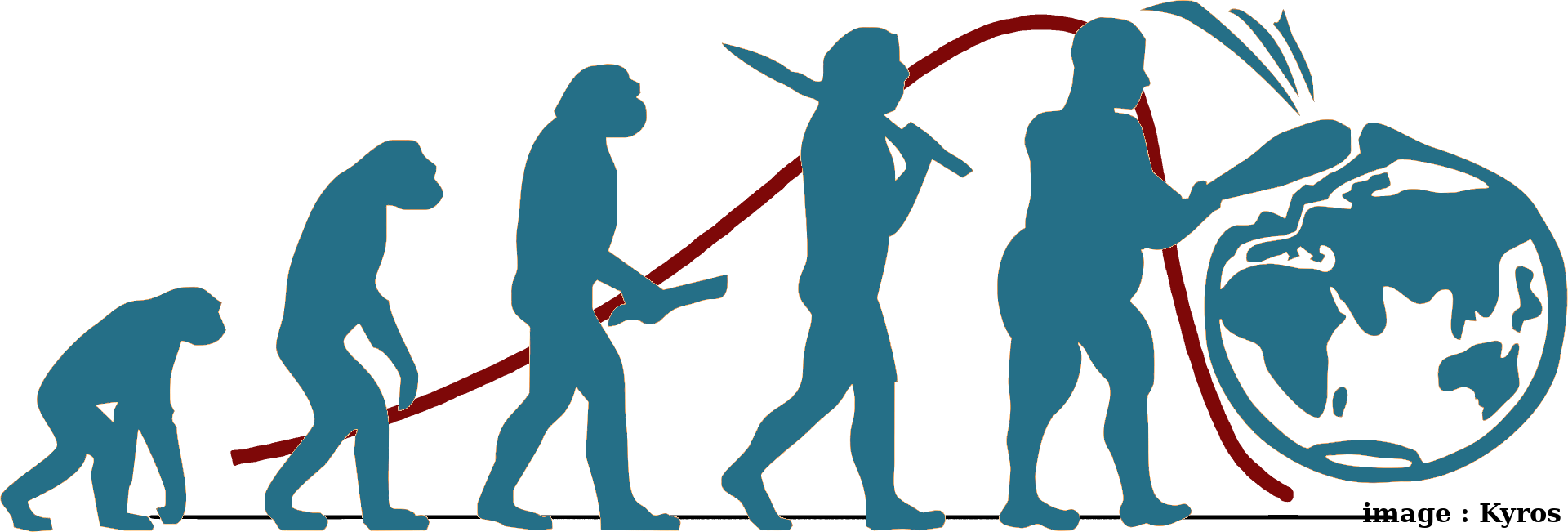

Il y a peu, le PDG de la société Anthropic a publié un long essai dans lequel il évoque les dangers que l’on peut associer à l’intelligence artificielle. Si Dario Amodei propose également quelques solutions, la publication fait plutôt froid dans le dos. En effet, l’intéressé qualifie notamment les IA d’imprévisibles et difficiles à contrôler.

Dario Amodei questions if human systems are ready to handle the ‘almost unimaginable power’ that is ‘potentially imminent’

2025

La start-up américaine d’intelligence artificielle a choisi la voie de l’accord financier avec les auteurs, leurs ayants droit et les éditeurs. Elle est poursuivie pour avoir téléchargé des œuvres à partir de sites pirates, afin d’alimenter ses modèles d’IA.

Ce concurrent d’OpenAI, spécialisé dans l’intelligence artificielle destinée aux entreprises, a annoncé une levée de fonds de 13 milliards de dollars. Elle dit générer 5 milliards de dollars de chiffre d’affaires annuel, sans être bénéficiaire.

Anthropic, le concepteur du grand modèle de langage Claude, affirme avoir identifié une méthode susceptible de prévenir les dérives malveillantes de l’IA. Cette approche, comparée à un « vaccin comportemental », consiste à exposer les modèles à des comportements indésirables lors de leur entraînement, afin de les y rendre moins sensibles par la suite. Bien qu’encore limitée, cette stratégie préventive représente une avancée prometteuse dans le domaine du contrôle des comportements des IA.