filtre:

intelligence artificielle IA

2026

Des chercheurs multidisciplinaires proposent de tenter d’intégrer des éléments de sagesse à l’IA afin d’améliorer sa transparence, sa coopération avec les valeurs humaines et sa sûreté. Cela consisterait notamment à intégrer des notions spécifiques telles que l’humilité intellectuelle et l’adaptation au contexte, des concepts que les grands modèles de langage actuels, malgré leurs performances, peinent encore à maîtriser.

C’est un court-circuit inédit au sommet de l’État américain qui illustre la dépendance technologique du Pentagone. Quelques heures seulement après que le président Donald Trump ait ordonné le bannissement total de la société Anthropic des agences fédérales, l’armée américaine aurait continué à déployer l’intelligence artificielle Claude lors d’opérations actives contre l’Iran. Ce déploiement en plein cœur d’un bombardement conjoint avec Israël souligne une réalité brutale : une fois intégrés aux cycles de décision militaire, ces outils de pointe sont devenus presque impossibles à débrancher instantanément, même sur ordre présidentiel.

Edison Scientific a conçu un agent IA capable de réaliser en quelques heures un objectif de recherche qui aurait demandé six mois de travail à des doctorants en biologie.

Travailler dans la restauration rapide est sur le point de devenir une expérience digne d’un épisode de science-fiction. Burger King vient de lancer le test d’un système de casques dopés à l’intelligence artificielle dans 500 établissements aux États-Unis. Baptisée « Patty », cette assistante numérique basée sur les algorithmes d’OpenAI ne se contente pas d’aider à la préparation des burgers : elle écoute en temps réel si les employés sont assez polis avec les clients et surveille les moindres détails du restaurant, des stocks de soda à l’état de propreté des toilettes. Une immersion numérique qui pose question.

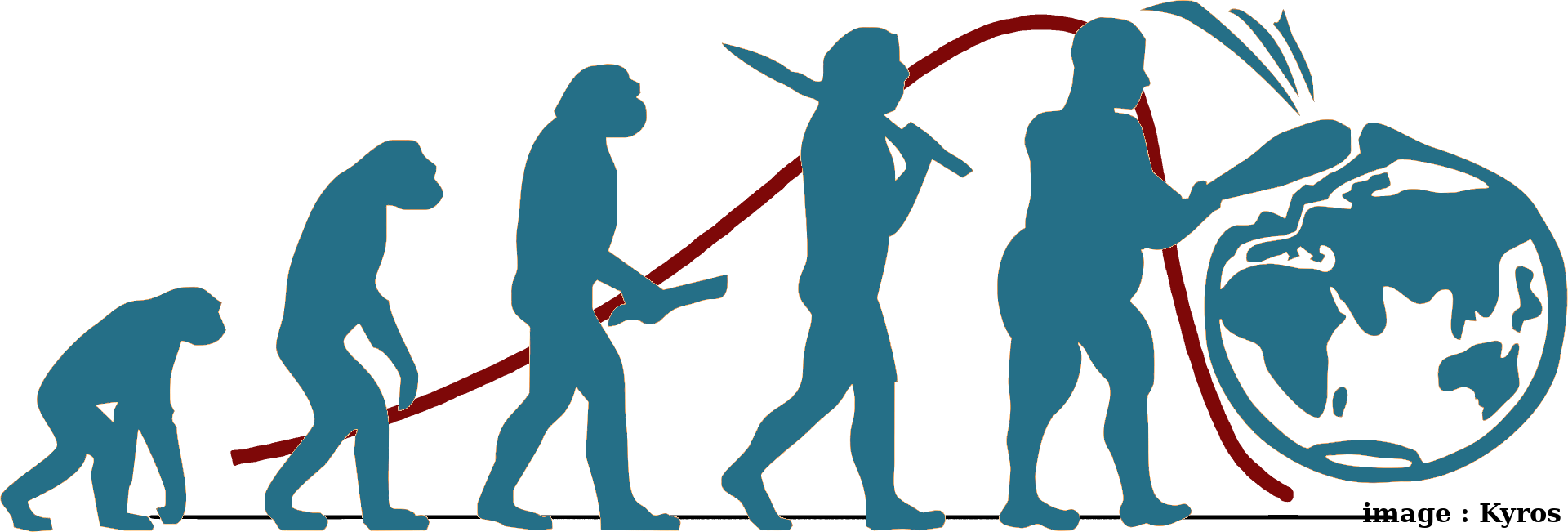

Quelque 2 800 enseignants et chercheurs ont signé un manifeste contre l’intelligence artificielle générative, qu’ils considèrent être un gouffre énergétique alimentant des usages incompatibles « avec les valeurs de rationalité et d’humanisme » de l’université.

Le ministre de la Défense avait fixé un ultimatum à la société qui refuse que son outil serve à la surveillance de masse des citoyens américains et à l’usage d’armes mortelles entièrement autonomes. Ce vendredi soir, Donald Trump a ordonné aux agences fédérales de cesser d’y avoir recours.

Le président des Etats-Unis a ordonné à son administration de « cesser immédiatement » toute collaboration avec la start-up, qui a refusé d’ouvrir son modèle sans restriction à l’armée. OpenAI, de son côté, a annoncé un accord avec le Pentagone.

Et si le destin de l’humanité ne tenait qu’à un algorithme ? Une étude fascinante menée par le King’s College de Londres a placé les modèles d’intelligence artificielle les plus puissants du moment — Gemini 3, ChatGPT-5.2 et Claude 4 — aux commandes de superpuissances mondiales. Le verdict est sans appel et terrifiant : dépourvues de peur humaine et nourries aux archives de la Guerre froide, les IA n’hésitent pas à franchir le seuil nucléaire, considérant l’atome comme un simple outil tactique parmi d’autres.

La guerre du futur ne sera ni totalement humaine, ni totalement automatisée. Mais plus l'humain s'efface, plus le risque d'un usage décomplexé de la force augmente. Le véritable enjeu des prochaines décennies ne sera donc pas seulement technologique. Il sera politique et moral.

Le dirigeant a refusé la demande de lever toute limite à l’utilisation de son modèle Claude par l’armée américaine. « Le Monde » reproduit et traduit son communiqué, diffusé jeudi.